SEO kỹ thuật là gì? Nguyên tắc cơ bản và thực hành tốt

Trần Minh Phương Anh

24 tháng 4, 2026

SEO kỹ thuật là gì? Nguyên tắc cơ bản và thực hành tốt

Nhiều doanh nghiệp vẫn xem SEO kỹ thuật như phần việc phụ, chỉ xử lý sau khi đã viết đủ content. Cách làm này khiến bot khó thu thập dữ liệu, trang bị lập chỉ mục chậm và tín hiệu xếp hạng bị rò rỉ. Bài viết này giải thích nền tảng và cách triển khai đúng. Cùng MangoAds tìm hiểu trong bài viết dưới đây!

SEO kỹ thuật là gì?

SEO kỹ thuật là phần tối ưu giúp công cụ tìm kiếm thu thập, kết xuất và hiểu website một cách chính xác.

Nó không chỉ là sửa lỗi trong báo cáo công cụ. SEO kỹ thuật là lớp hạ tầng quyết định trang nào được nhìn thấy, nội dung nào được ưu tiên, và tín hiệu nào được gom lại thành một thực thể rõ ràng. Nếu cấu trúc URL, thẻ chuẩn hóa, hoặc khả năng hiển thị của nội dung có vấn đề, content tốt vẫn có thể bị bỏ sót hoặc bị hiểu sai.

Về bản chất, SEO kỹ thuật bao gồm kiến trúc website, sơ đồ trang XML, khả năng thu thập dữ liệu, khả năng kết xuất bằng JavaScript, quản lý chỉ mục, tốc độ tải trang, khả năng dùng trên di động và các tín hiệu chuẩn hóa như canonical, noindex, robots.txt, structured data. Đây là nền tảng để công cụ tìm kiếm đọc website theo đúng ý đồ mà doanh nghiệp thiết kế.

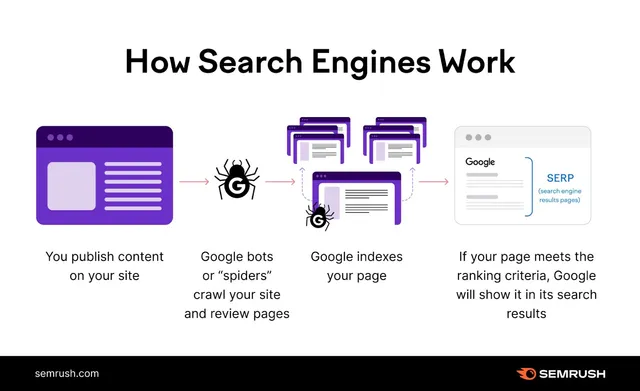

Cơ chế của SEO kỹ thuật nằm ở chỗ công cụ tìm kiếm không xếp hạng một trang vì “nó có nội dung hay” rồi mới đọc sau. Trình tự thường là phát hiện URL, thu thập dữ liệu, kết xuất, lập chỉ mục, rồi mới đánh giá mức phù hợp để xếp hạng. Nếu một mắt xích trong chuỗi này bị chặn, toàn bộ giá trị của content và liên kết bên ngoài sẽ đến chậm hoặc không đến được nơi cần đến. Đội ngũ MangoAds thường bắt đầu audit từ lớp kỹ thuật trước khi chạm vào content, vì một trang không crawl được thì mọi tối ưu phía sau đều chỉ cải thiện trên giấy.

Vì sao SEO kỹ thuật quyết định hiệu quả SEO tổng thể?

SEO kỹ thuật quyết định hiệu quả SEO tổng thể vì nó cho phép Google nhìn thấy giá trị thực của website.

Nếu content là phần thông điệp, thì SEO kỹ thuật là con đường để thông điệp đó đến được với công cụ tìm kiếm. Một bài viết có insight tốt nhưng bị chặn bởi robots.txt, gắn canonical sai, hay render lỗi trên JavaScript vẫn có thể không được lập chỉ mục đúng cách. Trong trường hợp đó, lỗi không nằm ở nội dung, mà ở việc nội dung không được công cụ tìm kiếm đọc như kỳ vọng.

Cơ chế này đặc biệt rõ ở các website thương mại điện tử, bất động sản, tuyển sinh, và tin tức tại Việt Nam. Những website này thường có nhiều bộ lọc, nhiều biến thể URL, và nhiều nội dung sinh ra từ hệ quản trị nội dung. Nếu không kiểm soát tốt, Google có thể index nhầm trang lọc, bỏ sót trang có giá trị chuyển đổi, hoặc phân tán tín hiệu sang hàng loạt URL gần giống nhau. Khi đó, cùng một công sức sản xuất content lại tạo ra hiệu quả rất khác nhau chỉ vì nền kỹ thuật xử lý chưa gọn.

Điểm quan trọng nữa là technical SEO giúp tích lũy hiệu quả theo thời gian. Khi nền kỹ thuật đã ổn, mỗi bài viết mới, mỗi liên kết nội bộ, và mỗi backlink mới đều phát huy tác dụng rõ hơn vì không bị thất thoát qua các tầng lỗi. Ngược lại, nếu nền này yếu, doanh nghiệp phải bù lỗi máy móc bằng rất nhiều content hoặc ngân sách phân phối, mà hiệu quả vẫn khó ổn định. Điều doanh nghiệp cần nhớ là tối ưu kỹ thuật không thay thế content, nhưng nó quyết định content có được “đọc” đúng hay không.

Google thu thập dữ liệu như thế nào và tối ưu ra sao?

Google không đọc website theo cách con người đọc giao diện.

Trong thực tế, bot đi theo liên kết, trạng thái phản hồi của máy chủ, lệnh trong robots.txt, và mức độ hợp lý của cấu trúc site. Nếu trang chủ không dẫn rõ đến trang danh mục, nếu trang danh mục không dẫn đến trang con, hoặc nếu nội dung chỉ xuất hiện sau khi script chạy xong, bot sẽ mất nhiều thời gian hơn để hiểu mối quan hệ giữa các trang. Vì vậy, tối ưu crawlability là bài toán thiết kế đường đi cho máy đọc, không chỉ là bài toán có hay không có nội dung.

Kiến trúc website thân thiện với SEO

Kiến trúc website thân thiện với SEO bắt đầu từ cấu trúc phân cấp rõ ràng. Trang chủ nên dẫn đến các trang trụ cột, trang trụ cột dẫn đến nhóm chủ đề, và nhóm chủ đề dẫn đến từng trang chi tiết. Cấu trúc này giúp bot đi từ điểm có độ tin cậy cao sang các trang con, đồng thời cho Google thấy đâu là nội dung trung tâm, đâu là nội dung vệ tinh. Nếu website có quá nhiều tầng nhấp chuột hoặc nhiều trang mồ côi không có liên kết nội bộ trỏ tới, khả năng crawl và giá trị ngữ nghĩa đều giảm.

Sơ đồ trang XML và gửi tín hiệu cho Google

Sơ đồ trang XML là bản đồ gợi ý, không phải lệnh bắt buộc. Nó giúp Google biết những URL nào cần ưu tiên phát hiện, đặc biệt với website có nhiều trang mới hoặc nhiều trang khó lần theo từ menu. Gửi sitemap qua Google Search Console giúp đẩy nhanh quá trình phát hiện, nhưng không thể bù cho kiến trúc site rối hoặc nội dung bị chặn index. Một sai lầm phổ biến là đưa cả URL noindex vào sitemap, khiến bot nhận tín hiệu mâu thuẫn và làm loãng chất lượng bản đồ.

Cho phép đúng bot thu thập dữ liệu

Tệp robots.txt dùng để điều tiết bot nào được đi vào khu vực nào của website. Nó nên chặn khu vực quản trị, giỏ hàng, trang thử nghiệm, hoặc URL sinh ra từ bộ lọc vô tận, nhưng không nên chặn những tài nguyên mà bot cần để render giao diện như CSS và JavaScript. Nếu doanh nghiệp muốn nội dung xuất hiện trong các hệ tìm kiếm tích hợp AI, cần kiểm tra riêng quy tắc cho các bot phù hợp, thay vì chặn theo cảm tính. Một dòng cấm sai có thể làm mất cả khả năng thu thập lẫn khả năng hiện diện trên lớp tìm kiếm mới.

Kết xuất JavaScript và khả năng thu thập

Kết xuất JavaScript là điểm dễ gây hiểu nhầm nhất. Nhiều website hiện đại hiển thị nội dung qua ứng dụng một trang hoặc qua lớp tương tác động, nhưng nếu phần nội dung quan trọng chỉ xuất hiện sau khi script chạy xong, bot có thể thấy trang trống, thấy nội dung muộn, hoặc phải tốn thêm tài nguyên để render lại. Cách an toàn hơn là đảm bảo phần nội dung cốt lõi có thể đọc được ngay từ HTML đầu vào hoặc dùng kết xuất phía máy chủ khi cần. Trong các dự án có nhiều danh mục và bộ lọc, MangoAds thường ưu tiên kiểm tra crawl path trước, vì lỗi render và lỗi kiến trúc thường cùng lúc làm bot bỏ sót những trang quan trọng nhất.

Kiểm soát lập chỉ mục và xử lý lỗi kỹ thuật

Lập chỉ mục là bước Google quyết định trang nào xứng đáng xuất hiện trên kết quả tìm kiếm.

Nếu thu thập dữ liệu là “đi qua”, thì lập chỉ mục là “lưu vào hệ thống”. Một trang có thể được crawl nhưng không được index nếu Google thấy nó trùng lặp, quá yếu, bị chặn bởi noindex, hoặc có tín hiệu chuẩn hóa mâu thuẫn. Vì vậy, kiểm soát index không phải là cấm bot càng nhiều càng tốt, mà là chỉ cho phép những trang thực sự có giá trị xuất hiện trong SERP.

Dùng noindex và canonical đúng chỗ

Thẻ noindex nói với công cụ tìm kiếm rằng trang có thể được thu thập nhưng không nên xuất hiện trên kết quả tìm kiếm. Thẻ canonical lại gom tín hiệu về một phiên bản gốc khi có nhiều URL gần giống nhau. Hai thẻ này không thay thế nhau. Noindex dùng khi trang không có giá trị tìm kiếm, còn canonical dùng khi trang có nội dung gần trùng nhưng vẫn cần tồn tại cho người dùng, như trang lọc, trang phân loại hoặc biến thể URL. Nếu dùng canonical sai, Google có thể dồn tín hiệu về trang không phù hợp; nếu dùng noindex bừa, doanh nghiệp có thể tự xóa mất những trang đang mang traffic tốt.

Tối ưu tốc độ, di động và dữ liệu có cấu trúc

Tốc độ tải trang và khả năng dùng trên di động đã trở thành phần cứng của SEO hiện đại. Core Web Vitals phản ánh ba yếu tố quan trọng: tốc độ nội dung lớn nhất xuất hiện, độ phản hồi khi người dùng tương tác, và độ ổn định của bố cục. Đây không chỉ là điểm số kỹ thuật. Chúng ảnh hưởng trực tiếp đến tỷ lệ thoát, mức độ hài lòng, và khả năng Google đánh giá trải nghiệm trang. Dữ liệu có cấu trúc giúp công cụ tìm kiếm hiểu rõ loại nội dung, như sản phẩm, bài viết, công thức, hoặc câu hỏi thường gặp. Breadcrumb cũng góp phần làm rõ cấu trúc điều hướng, còn phân trang giúp bot hiểu cách tách các trang danh sách lớn thành những phần có thể xử lý.

Dọn trùng lặp, trang lỗi và robots.txt

Trùng lặp nội dung không chỉ là chép nguyên văn. Nó còn là tình trạng nhiều URL khác nhau hiển thị gần như cùng một nội dung vì tham số lọc, chuẩn giao thức không thống nhất, hoặc phiên bản có và không có www cùng tồn tại. Một website chỉ nên có một phiên bản chuẩn để truy cập và được bot hiểu. Khi http, https, www, không www, hoặc đuôi dấu gạch chéo đều mở như các trang riêng biệt, tín hiệu sẽ bị phân tán. Trang lỗi 4xx, chuỗi chuyển hướng dài, và liên kết nội bộ trỏ vào URL hỏng cũng làm crawl budget bị lãng phí. Quy trình MangoAds chuẩn hóa khi xử lý technical debt thường bắt đầu bằng việc gom các lỗi theo nhóm ảnh hưởng đến index, render và phân phối tín hiệu, vì sửa lẻ tẻ từng lỗi rất dễ bỏ sót mối liên hệ giữa canonical, pagination và duplicate URL.

Khi website có nhiều ngôn ngữ hoặc nhiều định dạng

Nếu website phục vụ nhiều ngôn ngữ, thẻ hreflang giúp Google hiểu phiên bản nào dành cho thị trường nào. Nếu cùng một thực thể xuất hiện ở nhiều định dạng khác nhau, như bài viết, sản phẩm, và dữ liệu trên trang chi tiết, tên gọi và thông tin phải nhất quán. Khi một trang nói một kiểu, dữ liệu có cấu trúc nói một kiểu khác, còn tiêu đề hiển thị lại khác nữa, công cụ tìm kiếm sẽ khó xác định đâu là phiên bản đáng tin nhất. Với website đa ngôn ngữ, đa định dạng, hoặc nhiều trang chi tiết gần giống nhau, kỹ thuật chuẩn hóa không phải phần phụ, mà là cách bảo vệ toàn bộ hệ thống tín hiệu khỏi bị nhiễu.

MangoAds — SEO kỹ thuật cho website bền vững

SEO kỹ thuật không chỉ là xử lý lỗi trong báo cáo. Nó quyết định những gì công cụ tìm kiếm nhìn thấy, cách tín hiệu được gom lại và tốc độ website chuyển thành hiệu quả tìm kiếm.

Đội ngũ MangoAds xây dựng quy trình audit kỹ thuật theo từng lớp, từ crawlability đến indexability, để ưu tiên đúng vấn đề trước khi mở rộng content.

Nếu bạn muốn xây dựng nền tảng SEO vững hơn, MangoAds có thể hỗ trợ:

- Audit SEO kỹ thuật toàn diện, xác định lỗi ảnh hưởng trực tiếp đến crawl và index

- Thiết kế lại kiến trúc website và luồng liên kết nội bộ theo cụm chủ đề

- Ưu tiên roadmap xử lý technical debt theo mức độ tác động đến traffic và chuyển đổi

Đặt lịch tư vấn miễn phí

Câu hỏi thường gặp

SEO kỹ thuật có quan trọng hơn content SEO không?

Không thể tách hai phần này thành một cuộc so sánh đơn giản. Content SEO tạo ra giá trị thông tin, còn SEO kỹ thuật bảo đảm giá trị đó được thu thập và hiểu đúng. Nếu nền kỹ thuật lỗi, content tốt vẫn có thể không phát huy hết tác dụng.

Website nhỏ có cần sitemap và canonical không?

Có, dù quy mô nhỏ hay lớn. Sitemap giúp công cụ tìm kiếm phát hiện trang nhanh hơn, còn canonical giúp tránh tình trạng nhiều URL gần giống nhau cạnh tranh tín hiệu với nhau. Với website nhỏ, việc này thường dễ làm hơn và nên chuẩn hóa từ đầu.

Bao lâu nên audit SEO kỹ thuật một lần?

Nên audit định kỳ theo nhịp thay đổi của website, đặc biệt sau khi ra mắt giao diện mới, thêm tính năng lọc, đổi CMS, hoặc mở thêm ngôn ngữ. Nếu website thay đổi thường xuyên, technical SEO nên được kiểm tra liên tục thay vì chờ đến khi traffic giảm mới xử lý.

Chặn bot bằng robots.txt có làm mất traffic không?

Có thể, nếu chặn nhầm những khu vực cần được thu thập hoặc chặn luôn tài nguyên phục vụ render. robots.txt nên dùng để điều tiết khu vực không cần index, không phải để giấu mọi thứ khỏi công cụ tìm kiếm. Trước khi chỉnh file này, cần kiểm tra kỹ tác động đến CSS, JavaScript và các trang có giá trị.

Khi nào nên ưu tiên sửa lỗi kỹ thuật trước khi viết thêm content?

Khi website đang có vấn đề về crawl, index, trùng lặp URL, tốc độ tải, hoặc render JavaScript. Trong những trường hợp đó, viết thêm content chỉ làm tăng khối lượng nội dung mà bot vẫn chưa đọc đúng. Sửa nền trước rồi mở rộng content sau luôn là cách an toàn hơn.

Khám Phá

Tại sao các công cụ SEO không phải lúc nào cũng đáng tin?

Google công nhận nhà sáng tạo nội dung đánh dấu một bước tiến mới cho E-E-A-T và SEO

Phân tích mức độ tương tác của đối thủ hiệu quả hơn với công cụ Google trends

SEO kỹ thuật là gì? Nguyên tắc cơ bản và thực hành tốt

SEO kỹ thuật quyết định bot có thu thập, kết xuất và lập chỉ mục đúng cách hay không. Bài viết giải thích nguyên tắc và thực hành tốt.