Google I/O 2025 có gì mới? Những thay đổi đáng chú ý

Trần Minh Phương Anh

24 tháng 4, 2026

Google I/O 2025 có gì mới? Những thay đổi đáng chú ý

Google I/O 2025 cho thấy một bước chuyển rất rõ của Google: AI không còn là lớp trình diễn nằm bên ngoài sản phẩm, mà đang trở thành hạ tầng mặc định bên trong Search, Gemini, Chrome và cả thiết bị đeo. Điều đáng chú ý không chỉ là số lượng thông báo, mà là cách Google ghép mô hình, giao diện và phần cứng thành một hướng đi thống nhất.

Nếu nhìn ở bề mặt, sự kiện này có vẻ như một chuỗi nâng cấp rải đều cho nhiều sản phẩm. Nhưng nhìn kỹ hơn, đây là thời điểm Google đẩy mạnh cùng lúc ba hướng: nâng chất lượng mô hình Gemini, làm Search thông minh hơn theo kiểu đối thoại, và thử định nghĩa lại thiết bị cá nhân bằng Android XR. Với người dùng phổ thông, đây là tín hiệu cho thấy trải nghiệm tra cứu, làm việc và giao tiếp với AI sẽ thay đổi nhanh hơn trong vòng một đến hai năm tới.

Sự kiện Google I/O 2025 diễn ra khi nào?

Google I/O 2025 diễn ra vào ngày 20 và 21 tháng 5 năm 2025 tại Shoreline Amphitheatre, Mountain View, California.

Đây là sự kiện thường niên lớn nhất của Google dành cho lập trình viên, nhưng năm 2025 có cảm giác khác hẳn những năm trước. Thay vì dàn trải thông tin theo từng mảng sản phẩm, Google gom hầu hết thông báo quan trọng quanh một trục duy nhất là AI. Cách làm này cho thấy Google không còn xem AI là một tính năng bổ sung, mà là lớp nền để các sản phẩm hiện có hoạt động thông minh hơn, cá nhân hơn và chủ động hơn.

Điểm đáng chú ý ở I/O không phải chỉ là ngày diễn ra hay sân khấu tổ chức. Giá trị thật của hội nghị nằm ở cách Google dùng nó để đồng bộ chiến lược. Một keynote như vậy thường nối ba tầng với nhau: mô hình mới, sản phẩm mới và nền tảng triển khai mới. Khi ba tầng này khớp nhau, Google có thể đẩy cùng một năng lực xuống Search, Gemini, Workspace hay Android mà không phải xây lại trải nghiệm từ đầu. Với người theo dõi công nghệ, đây là cách đọc roadmap rất hiệu quả.

Cơ chế của I/O 2025 vì thế khá rõ. Google dùng sân khấu lớn để hợp thức hóa các thay đổi đã chín tới, rồi đẩy chúng vào hệ sinh thái theo từng mức độ sẵn sàng khác nhau. Một số thứ có thể dùng ngay, như Gemini Live miễn phí trên điện thoại. Một số thứ chỉ mở cho thị trường Mỹ hoặc nhóm thuê bao cao cấp, như AI Mode hay Gemini trong Chrome. Một số khác vẫn là bước thử nghiệm, như Android XR trên kính thông minh. Sự phân tầng này cho thấy Google đang triển khai AI theo đúng kiểu nền tảng: phần nào đủ ổn thì tung ra, phần nào còn non thì tiếp tục hoàn thiện.

Gemini là phần thay đổi sâu nhất

Gemini

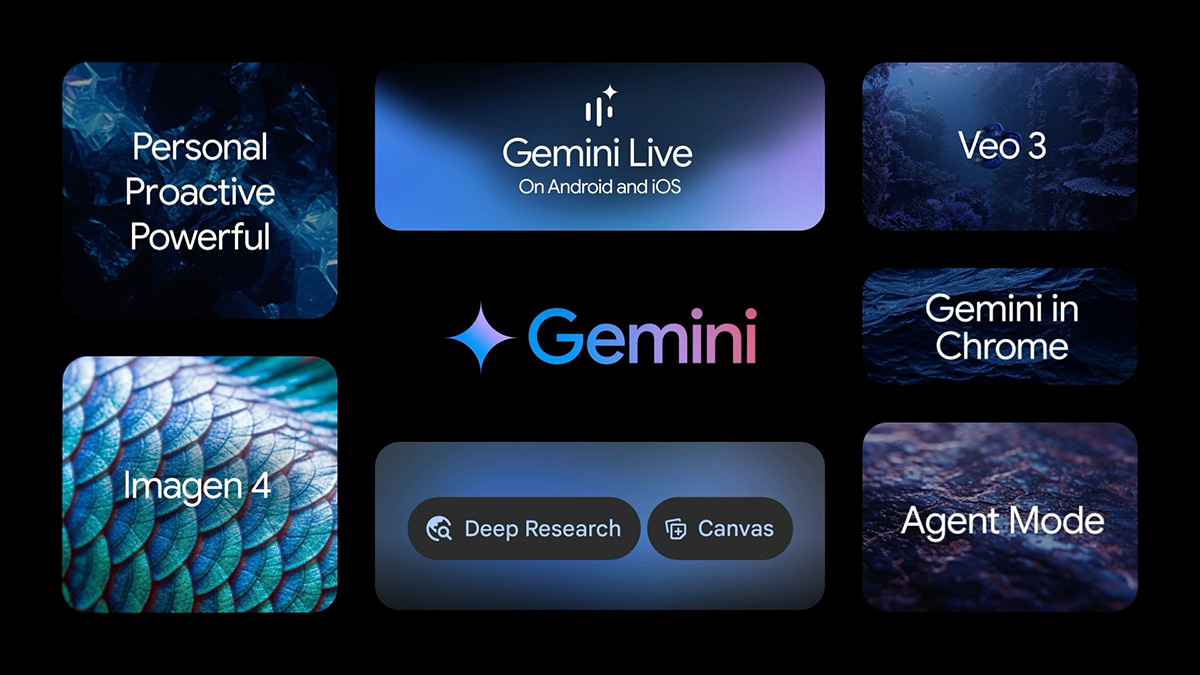

Google I/O 2025 xoay rất mạnh quanh Gemini, và đây là mảng thay đổi có tác động trực tiếp nhất đến cách người dùng tương tác với Google.

Trên bình diện mô hình, Gemini 2.5 Pro tiếp tục được đẩy lên như lựa chọn mạnh nhất cho các tác vụ suy luận và lập trình, còn Gemini 2.5 Flash trở thành mô hình mặc định mới vì tốc độ cao và chi phí thấp hơn. Google cũng nhắc tới Deep Think, một chế độ suy luận nâng cao đang ở dạng thử nghiệm cho 2.5 Pro. Với người dùng thông thường, các tên gọi này nghe rất kỹ thuật, nhưng ý nghĩa thực tế lại đơn giản: Gemini đang được tối ưu để trả lời nhanh hơn ở tác vụ nhẹ, và suy luận sâu hơn ở tác vụ phức tạp. Đây là cách Google tách rõ giữa tốc độ và độ chính xác, thay vì ép một mô hình phải làm mọi thứ theo cùng một kiểu.

Trong các bài phân tích của Việt Nam Technology Reviews, điểm đáng chú ý nhất không nằm ở một tính năng đơn lẻ, mà ở cách Google biến Gemini từ chatbot thành một lớp trợ lý đa phương thức. Gemini Live với camera và chia sẻ màn hình được mở miễn phí trên Android và iOS, nghĩa là người dùng có thể chỉ vào vật thể, trang web hoặc màn hình đang mở rồi nói chuyện trực tiếp với AI. Cơ chế này làm giảm đáng kể ma sát nhập liệu. Thay vì phải mô tả dài dòng, người dùng đưa ngữ cảnh cho AI theo đúng cách con người quan sát thế giới. Đó là bước chuyển rất quan trọng vì nó thay đổi hẳn giao diện tương tác, từ gõ lệnh sang làm việc trong thời gian thực.

Google cũng đẩy mạnh hệ sinh thái xung quanh Gemini. Imagen 4 mang lại khả năng tạo ảnh tốt hơn, chữ trong ảnh rõ hơn và tốc độ nhanh hơn. Veo 3 tạo video có âm thanh gốc, bao gồm hiệu ứng âm thanh, tiếng nền và hội thoại giữa các nhân vật. Deep Research và Canvas được mở rộng để phục vụ nghiên cứu sâu, tạo nội dung và dựng website ở mức thử nghiệm. Gemini trong Chrome giúp AI đi thẳng vào trình duyệt, còn gói Google AI Ultra đưa người dùng cao cấp tới các tính năng sớm hơn với giới hạn sử dụng cao hơn. Nói cách khác, Gemini không còn đứng riêng như một ứng dụng, mà đang trở thành đầu vào cho nhiều lớp công cụ khác nhau.

Với người dùng Việt Nam, điều quan trọng là phải nhìn Gemini theo hướng ứng dụng thực tế. Những gì hữu ích nhất lúc này không phải là các demo hào nhoáng, mà là khả năng tóm tắt tài liệu, giải thích nội dung trên màn hình, hỗ trợ nghiên cứu, và giảm thời gian chuyển đổi giữa các công cụ. Cái giá phải trả là Google vẫn triển khai theo từng thị trường, từng gói thuê bao, và chưa phải tính năng nào cũng đến cùng lúc với người dùng ở Việt Nam. Dù vậy, xu hướng đã rất rõ: Gemini đang đi từ vai trò trả lời câu hỏi sang vai trò điều phối công việc.

Search và các ứng dụng Google cùng bước vào thời AI

Google Search

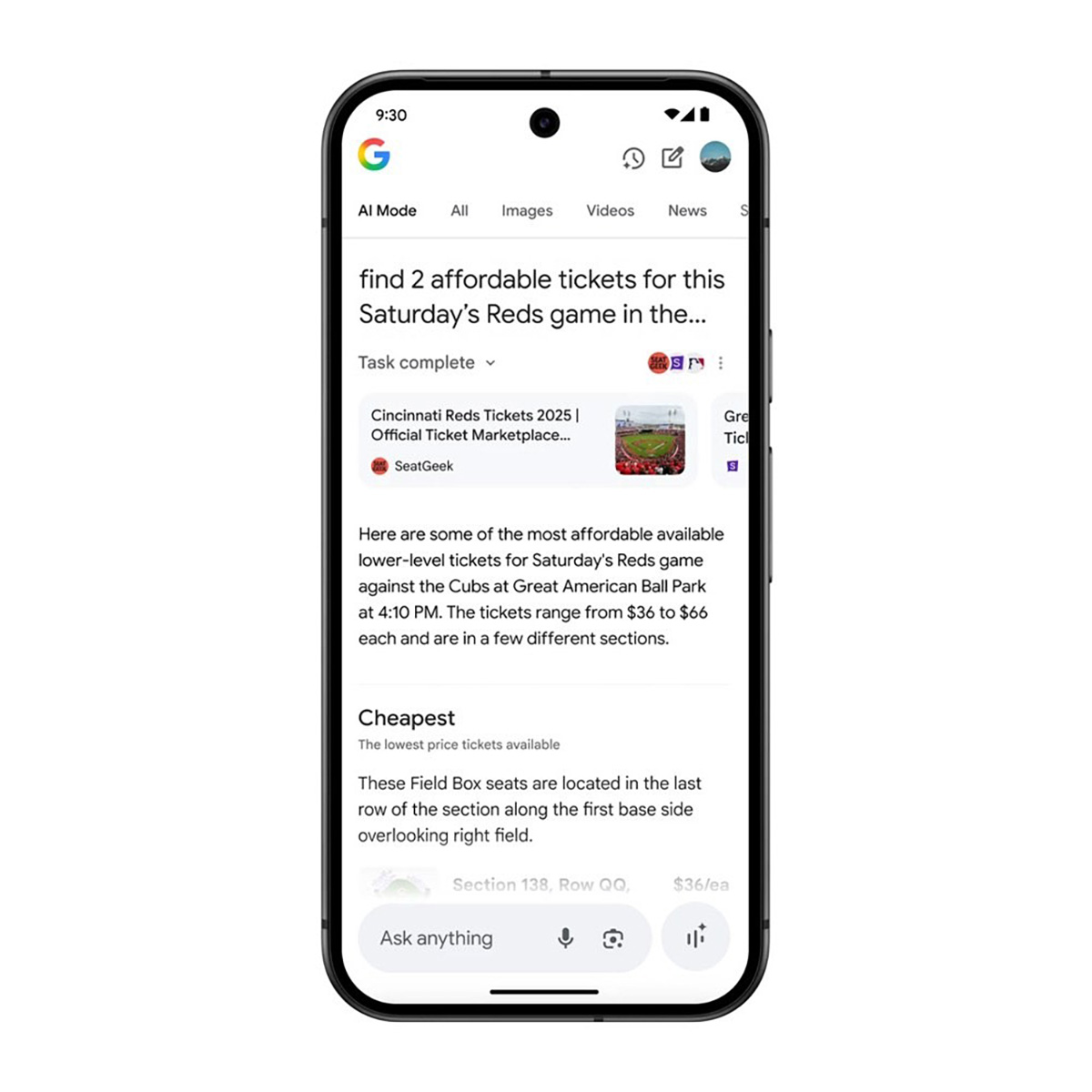

Google Search tại I/O 2025 không còn chỉ là thanh tìm kiếm với danh sách đường link.

Thay đổi nổi bật nhất là AI Mode, một tab mới trong Search cho phép người dùng hỏi các câu phức tạp hơn, dài hơn và có thể tiếp tục bằng câu hỏi nối tiếp. Google cũng đẩy Deep Search vào AI Mode trong Labs để hỗ trợ tra cứu sâu hơn. Điều này rất quan trọng vì nó cho thấy Google đang chuyển trọng tâm từ truy vấn ngắn, rời rạc sang đối thoại có ngữ cảnh. Nếu trước đây Search chủ yếu trả lời “đây là trang phù hợp nhất”, thì AI Mode hướng tới việc “đây là câu trả lời có cấu trúc nhất cho mục đích của bạn”.

Cơ chế của AI Mode khá dễ hiểu nếu tách nó thành ba bước. Đầu tiên là tiếp nhận câu hỏi dài và nhiều điều kiện hơn. Sau đó hệ thống dùng mô hình Gemini để suy luận, gom tín hiệu từ web và sắp xếp lại thông tin. Cuối cùng là trả về câu trả lời có tính tổng hợp cao hơn, thay vì chỉ ném cho người dùng một danh sách kết quả. Lợi ích rõ nhất nằm ở các tác vụ cần so sánh, lập kế hoạch hoặc nghiên cứu nhiều biến số. Ngược lại, với những truy vấn rất đơn giản như tìm giờ mở cửa hay tra một định nghĩa ngắn, AI Mode có thể là lớp trung gian hơi thừa. Đó là trade-off tự nhiên giữa sự tiện và sự nhanh.

Điểm mới ở đây không phải là Google bỏ Search truyền thống, mà là họ phủ thêm một lớp reasoning lên trên nó. Deep Search, AI Overviews và AI Mode cùng cho thấy một đường đi: Search vẫn dựa vào web, nhưng cách người dùng đi tới câu trả lời sẽ ít phụ thuộc vào việc tự lọc qua nhiều trang hơn. Với người làm nội dung, SEO và sản phẩm số ở Việt Nam, điều này buộc cách tối ưu thông tin phải thay đổi. Từ khóa vẫn cần, nhưng cấu trúc câu trả lời, tính rõ ràng của nội dung và khả năng phục vụ ý định tìm kiếm sẽ quan trọng hơn nhiều.

Google app và Workspace

Ở các ứng dụng Google khác, AI không xuất hiện ồn ào như trên sân khấu Search nhưng lại có tác động thực tế rất nhanh.

Google Meet là ví dụ điển hình cho hướng đi này. Khả năng dịch giọng nói gần thời gian thực cho thấy Google đang giải một bài toán rất đời thường: làm sao để cuộc họp xuyên ngôn ngữ vẫn giữ được nhịp trao đổi tự nhiên. Khi AI có thể dịch tức thì mà vẫn giữ nhịp nói, người dùng không còn bị kéo khỏi cuộc đối thoại chỉ để đọc phụ đề hoặc chờ phiên dịch. Điều đó đặc biệt hữu ích với nhóm làm việc quốc tế, đội bán hàng B2B, hoặc những người thường xuyên họp với đối tác ở nhiều múi giờ và ngôn ngữ khác nhau.

Google cũng tiếp tục đưa Gemini vào Chrome, nơi trình duyệt trở thành lớp làm việc mới thay vì chỉ là công cụ mở trang web. Với người dùng thuê bao cao cấp ở Mỹ, Gemini trong Chrome có thể giúp hỏi lại nội dung đang đọc, tóm tắt trang web, và về sau có thể hỗ trợ đi qua nhiều tab hoặc làm một số tác vụ điều hướng. Cơ chế này quan trọng vì nó đặt AI đúng ở nơi người dùng đang xử lý thông tin, thay vì bắt họ sao chép nội dung sang một công cụ khác. Với dân văn phòng hoặc sinh viên ở Việt Nam, tác động rõ nhất là giảm thời gian đọc tài liệu dài, soạn tóm tắt, hoặc kiểm tra nội dung trước khi gửi đi.

Khía cạnh đáng lưu ý là Google đang tung những tính năng này theo tầng dịch vụ rất rõ. Một số chỉ có trên thị trường Mỹ, một số cần gói AI Pro hoặc AI Ultra, và một số vẫn nằm trong diện thử nghiệm. Vì vậy, người dùng Việt Nam chưa nên nhìn I/O 2025 như danh sách tính năng có thể bật ngay, mà nên xem nó như bản đồ về hướng phát triển. Khi Google đưa dịch, tóm tắt và trợ lý vào ngay trong công cụ làm việc hằng ngày, cuộc cạnh tranh không còn nằm ở việc có AI hay không, mà nằm ở việc AI bám sát ngữ cảnh đến đâu.

Android XR mở đường cho kính và headset

Kính Android XR

Nếu Gemini và Search cho thấy Google muốn AI mạnh hơn trong phần mềm, thì Android XR cho thấy họ muốn AI đi ra khỏi màn hình điện thoại.

Android XR là nền tảng của Google cho headset và kính thông minh, được xây dựng để hoạt động cùng Gemini. Trên kính, thiết bị có camera, micro và loa, cùng một màn hình trong tròng tùy chọn để hiển thị thông tin riêng tư ngay trước mắt người dùng. Trên headset, Android XR cho phép trải nghiệm không gian ảo sâu hơn nhưng vẫn giữ khả năng quan sát môi trường xung quanh. Google cũng nói tới hợp tác với các thương hiệu kính như Gentle Monster và Warby Parker, cho thấy họ hiểu rất rõ một điều: kính thông minh chỉ có thể thành công nếu người dùng thật sự muốn đeo nó cả ngày.

Cơ chế của Android XR khác với điện thoại ở chỗ nó ưu tiên ngữ cảnh sống thay vì giao diện tĩnh. Khi kính nhìn thấy thứ người dùng đang nhìn, nghe được thứ người dùng đang nghe và hiển thị thông tin đúng thời điểm, AI có thể chuyển từ vai trò trả lời sang vai trò hỗ trợ chủ động. Điều này đặc biệt mạnh ở các tác vụ rảnh tay như điều hướng, dịch ngôn ngữ, nhắc lịch, chụp ảnh, hoặc đọc tóm tắt tin nhắn. Nhưng cũng chính vì vậy mà Android XR chịu áp lực rất lớn về pin, độ trễ, quyền riêng tư và thiết kế công thái học. Nếu kính quá nặng, quá lộ, hoặc phản hồi chậm, lợi thế ngữ cảnh sẽ nhanh chóng biến mất.

Với thị trường Việt Nam, use case thực tế nhất của Android XR có lẽ chưa phải là thay điện thoại, mà là giải quyết các tình huống rất cụ thể như đi công tác, tìm đường, giao tiếp với khách nước ngoài hoặc tra cứu thông tin ngay khi đang di chuyển. Trong mắt Việt Nam Technology Reviews, đây là một trong những mảng đáng theo dõi nhất vì nó cho thấy Google không chỉ muốn AI ở trong phần mềm, mà còn đang chuẩn bị cho một lớp giao diện mới của máy tính cá nhân. Nếu Android từng biến điện thoại thành trung tâm số, Android XR có thể sẽ thử biến kính và headset thành lớp tương tác tiếp theo.

Nhìn tổng thể, Google I/O 2025 không đưa ra một “siêu phẩm” đơn lẻ để gây sốc, mà mở ra một bản đồ chuyển dịch rất rõ: mô hình mạnh hơn, trợ lý thông minh hơn, tìm kiếm biết suy luận hơn và thiết bị đeo bắt đầu có vai trò thật. Đây là kiểu thay đổi ít ồn ào ở khoảnh khắc đầu, nhưng có khả năng định hình cách người dùng làm việc với công nghệ trong nhiều năm tới.

Câu hỏi thường gặp

Google I/O 2025 có gì khác so với các năm trước?

Khác biệt lớn nhất là AI trở thành trục trung tâm của toàn bộ sự kiện. Google không chỉ nói về mô hình Gemini, mà còn đưa AI vào Search, Chrome, ứng dụng cộng tác và Android XR. Điều đó cho thấy trọng tâm của hãng đã chuyển từ “thêm tính năng AI” sang “xây lại trải nghiệm xoay quanh AI”.

Gemini 2.5 có gì đáng chú ý nhất?

Gemini 2.5 Pro tiếp tục được Google đặt ở nhóm mô hình mạnh nhất cho suy luận và lập trình, còn 2.5 Flash được đẩy thành mô hình mặc định mới vì nhanh và hiệu quả hơn. Điểm đáng chú ý là Gemini giờ không chỉ trả lời, mà còn có Gemini Live, Deep Research, Canvas và các tích hợp sâu hơn với Chrome và các ứng dụng Google.

AI Mode trong Search có thay thế tìm kiếm truyền thống không?

Chưa. AI Mode là một lớp bổ sung trên Search, hướng tới các truy vấn phức tạp, nhiều điều kiện và cần đối thoại tiếp nối. Với truy vấn ngắn hoặc cần một thông tin rất nhanh, tìm kiếm truyền thống vẫn là lựa chọn phù hợp hơn.

Người dùng ở Việt Nam có thể trải nghiệm ngay những gì?

Những tính năng đến sớm nhất thường là các phần trong Gemini app, nhất là các chức năng tạo nội dung, hỗ trợ học tập và hỏi đáp bằng hình ảnh hoặc màn hình. Tuy nhiên, một số tính năng như AI Mode, Gemini trong Chrome hoặc các gói cao cấp vẫn phụ thuộc thị trường và mức triển khai của Google.

Android XR có phải là kính thay thế điện thoại không?

Chưa ở giai đoạn này. Android XR mới là bước đầu để Google thử một giao diện khác cho tác vụ rảnh tay, dịch ngôn ngữ, điều hướng và hỗ trợ theo ngữ cảnh. Giá trị thật của nó nằm ở việc mở ra một cách tương tác mới, chứ không phải thay điện thoại ngay lập tức.

Khám phá

Siri iOS 27: Chatbot AI thế hệ mới với Google Gemini

iOS 26.5 Beta 2: Apple nâng cấp Maps và chuẩn bị Siri thế hệ mới

Cách tính chu kỳ sạc cho pin 8000mAh: Nguyên lý và cách kiểm tra chất lượng

Tính năng AI của Galaxy S26 sẽ cập nhật cho Galaxy S25: Chiến lược phần mềm mới

Chiến lược Google Ads cho doanh nghiệp công nghệ: Từ nghiên cứu từ khóa đến tối ưu chuyển đổi

Điện thoại Trump T1: thiết kế và cấu hình mới lộ diện

Phân tích thiết kế và cấu hình Trump T1 vừa lộ diện, từ ngôn ngữ thiết kế đến ý nghĩa thực tế với người dùng và thị trường smartphone.

Samsung Galaxy Unpacked 2026: Có gì đáng chờ đợi?

Samsung Galaxy Unpacked 2026 được chờ đợi vì khả năng xuất hiện Galaxy S26, AI trên thiết bị, máy gập mới và chiến lược hệ sinh thái Galaxy.

Thị trường smartphone Việt 2025: giá rẻ thu hẹp, 5G tăng

Thị trường smartphone Việt 2025 đang dịch chuyển sang phân khúc tầm trung, trong khi điện thoại 5G tăng nhanh và dần trở thành lựa chọn mặc định.

Google I/O 2025 có gì mới? Những thay đổi đáng chú ý

Tổng hợp những thay đổi nổi bật tại Google I/O 2025, từ Gemini 2.5, AI Mode trong Search đến Android XR và các gói AI mới của Google.

iOS 26.5 Beta 2: Apple nâng cấp Maps và chuẩn bị Siri thế hệ mới

Apple phát hành iOS 26.5 Beta 2 với các cải tiến về Apple Maps, sửa lỗi bảo mật tin nhắn RCS và dọn đường cho Siri 2.0 tích hợp AI Gemini từ Google.

Tính năng AI của Galaxy S26 sẽ cập nhật cho Galaxy S25: Chiến lược phần mềm mới

Samsung xác nhận mang tính năng AI từ Galaxy S26 lên Galaxy S25 thông qua One UI 8.5, đánh giá khả năng thực tế và hạn chế phần cứng.